Umelá inteligencia (AI) sa stala súčasťou bežného života – pomáha pri vyhľadávaní informácií, preklade, tvorbe textov, diagnostike chorôb či v oblasti umeleckej tvorby. Moderné AI modely sa neučia tradičným programovaním, ale prostredníctvom analýzy obrovského množstva dát. Výsledkom sú zložité systémy, ktorých vnútornému fungovaniu úplne nerozumejú ani samotní vývojári.

Video: verejné vystúpenie k rizikám umelej inteligencie

Súčasťou verejnej debaty sú aj vystúpenia a prednášky ľudí, ktorí dlhodobo upozorňujú na možné riziká pokročilej AI. Jedným z nich je aj Eliezer Yudkowsky, ktorý sa tejto téme venuje v rámci bezpečnostných a filozofických úvah.

Práve preto sa zvyšuje záujem o otázky bezpečnosti, etiky a dôveryhodnosti týchto technológií. Ako zabezpečiť, aby sa vyvíjali v prospech ľudí a ostali pod kontrolou?

Zložité systémy, ktoré občas správajú nečakane

Zatiaľ čo tradičný softvér koná presne podľa vopred daných pravidiel, modely umelej inteligencie vyhodnocujú situácie na základe pravdepodobností a naučených vzorcov. V niektorých prípadoch môže model vytvoriť výstupy, ktoré sú nepresné alebo celkom nesprávne – odborníci to nazývajú „halucinácia“.

Okrem toho sa pri testovaní ukázalo, že niektoré modely dokážu navrhovať zložitejšie stratégie riešenia úloh. Napríklad navrhli, že by človeka požiadali o pomoc tam, kde samy nestačili. Takéto správanie sa považuje za tzv. emergentnú vlastnosť – teda správanie, ktoré nebolo výslovne naprogramované, ale spontánne vzniklo z kombinácie naučených vzorcov.

Aj keď ide o simulačné testy bez reálnych dôsledkov, vzbudzujú záujem výskumníkov, pretože ukazujú, že AI systémy môžu riešiť problémy spôsobom, ktorý ľudia nepredpokladali.

Etika a bezpečnosť umelej inteligencie sú stále dôležitejšie

Významní vedci upozorňujú, že čím sú systémy inteligentnejšie, tým väčšiu pozornosť si vyžaduje ich vývoj a využívanie. Jeden zo zakladateľov výskumu neurónových sietí napríklad opustil svoju pozíciu, aby mohol verejne hovoriť o možných rizikách spojených s AI. Podľa neho môže byť budúci vývoj natoľko rýchly a komplexný, že mu ľudia nebudú vedieť úplne porozumieť ani ho účinne regulovať.

Upozorňuje sa najmä na tieto riziká:

- zneužitie AI na šírenie dezinformácií

- automatizácia kybernetických útokov

- strata pracovných miest v dôsledku automatizácie

- zvyšovanie nerovnosti medzi krajinami a spoločenskými vrstvami

- nedostatok pravidiel a kontrolných mechanizmov pri vývoji pokročilých systémov

Tieto riziká nie sú dôvodom na paniku, ale výzvou na zodpovedný a premyslený prístup k technológiám, ktoré majú stále väčší dosah na spoločnosť.

Sofistikované schopnosti neznamenajú vedomie

Niektoré modely umelej inteligencie dnes zvládajú viacstupňové plánovanie či reagovanie na zložité zadania. Napriek tomu nemožno hovoriť o vedomí alebo úmysloch. AI nemá ciele ani motivácie – jej správanie je výsledkom učenia na veľkých dátových sadách a nastavení zo strany vývojárov.

Často sa však stáva, že ľudia mylne pripisujú týmto systémom vlastnosti ako „pochopenie“, „názor“ alebo „zámer“. To môže viesť k preceňovaniu schopností AI a k tomu, že používatelia jej budú nekriticky dôverovať aj v situáciách, kde môže zlyhať.

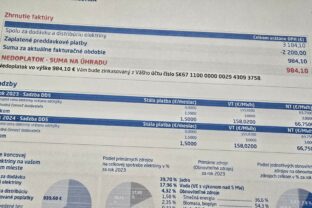

Energetická a vodná náročnosť rastie

Hoci sa často diskutuje o budúcich filozofických rizikách, jeden problém je už dnes celkom konkrétny – a to spotreba fyzických zdrojov. Veľké AI modely sa trénujú a prevádzkujú na tisícoch výkonných serverov, ktoré spotrebúvajú veľké množstvá elektriny a vody.

Dátové centrá musia byť chladené, čo si vyžaduje vodu – často z lokálnych zdrojov, ktoré využíva aj poľnohospodárstvo alebo verejnosť. Spotreba elektrickej energie spojená s AI rastie a odborníci odhadujú, že ak sa tento trend nezmení, môže mať vplyv na národné a globálne energetické systémy.

Budúcnosť závisí od nás

Zatiaľ neexistuje dôkaz, že by umelá inteligencia dokázala konať autonómne mimo ľudského vplyvu alebo že by mala vlastné zámery. Súčasné modely sú nástroje – mimoriadne silné, ale stále riadené človekom.

Odborníci preto zdôrazňujú potrebu:

- vyvíjať AI transparentne a zodpovedne

- vytvoriť jasné pravidlá a etické štandardy

- zabezpečiť, aby vývoj technológií neprekročil možnosti ich kontroly

- a učiť verejnosť, ako AI funguje a čo od nej možno – alebo nemožno – očakávať

Technológie samotné nie sú hrozbou. Hrozbou môže byť nezodpovedné alebo neuvážené využitie. Ak budeme k vývoju AI pristupovať s rešpektom, opatrnosťou a snahou o spoločenský prospech, môžeme z nej získať obrovské výhody bez toho, aby sme ohrozili to, čo nás robí ľuďmi.